NetApp EF600 acelera los datos para las plataformas de IA de Nvidia

- Noticias y Actualidad

El moderno sistema All Flash NetApp EF600 proporciona un nuevo nivel de rendimiento en el acceso a los datos para las plataformas de inteligencia artificial del fabricante Nvidia. Los expertos de NetApp han probado esta combinación ganadora en varias configuraciones, de uno y varios nodos DGX, demostrando su gran eficacia para la construcción de sistemas HPC de ultra baja latencia y gran ancho de banda, perfectos para las aplicaciones de IA más exigentes.

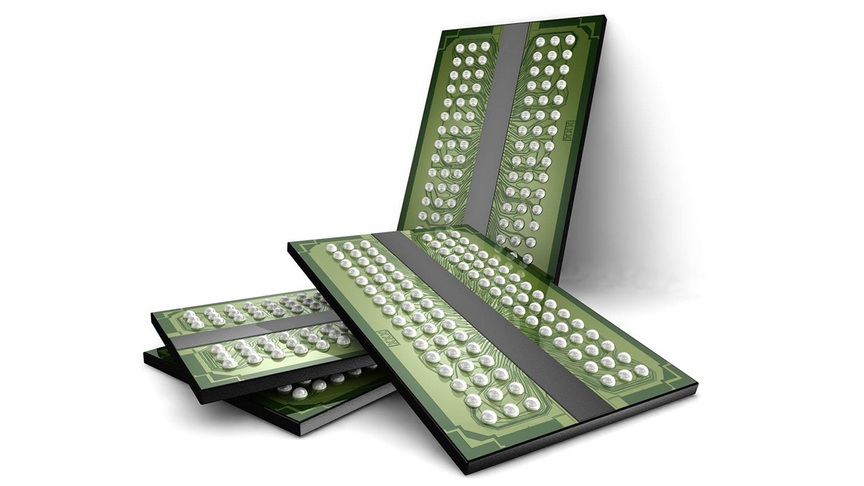

Con sus nuevas matrices All Flash de la serie EF, el proveedor de almacenamiento NetApp ha creado un sistema perfecto para las plataformas de inteligencia artificial más avanzadas y compactas del fabricante Nvidia, los sistemas DGX. Para extraer el máximo potencial de estos equipos se necesitan repositorios de datos de alto rendimiento, basados en unidades SSD ye interfaces de nueva generación que sean capaces de suministrar los datos que alimentan a la IA con la más baja latencia y el máximo ancho de banda.

Tradicionalmente, muchas aplicaciones de inteligencia artificial se han nutrido de los grandes conjuntos de datos alojados en plataformas de almacenamiento basadas en HDD con sistemas de aceleración. Pero al escalar las capacidades de IA estos sistemas se demuestran ineficientes, ya que se generan cuellos de botella e interrupciones que lastran el desempeño de las plataformas de computación de alto rendimiento (HPC). Por ello, la industria está apostando cada vez más por el almacenamiento All flash, sobre todo a raíz del lanzamiento de protocolos de red que establecen una gran diferencia en términos de rendimiento.

Esto está revolucionando la forma de trabajar en campos como el desarrollo de aplicaciones, el aprendizaje automático y profundo, la analítica de grandes volúmenes de datos o el procesamiento de vídeo. Pero la capacidad de escalamiento de cómputo y de almacenamiento siempre supone una limitación, y hacen falta plataformas que sean capaces de superar las barreras tradicionales de rendimiento en el acceso a los datos, como los últimos sistemas EF600 de NetApp.

Estos nuevos equipos, lanzados hace escasos meses, están demostrando ser el compañero ideal ara una de las plataformas de computación para IA más revolucionarias, compacta y solventes del mundo, que son los sistemas DGX A100 de Nvidia. Como demuestran las pruebas realizadas desde su lanzamiento, las matrices All Flash NetApp EF600, integradas con los nodos DGX A100 empleando el sistema de archivos BeeGFS con redes infiniband son un tándem perfecto para las aplicaciones más avanzadas de inteligencia artificial.

Así, el sistema NetApp EF600 AI permite simplificar las implementaciones de inteligencia artificial y prescindiendo de la complejidad de otras arquitecturas y garantizando los más altos estándares de rendimiento y fiabilidad, en un formato ultracompacto, líder en la industria. Los ingenieros de NetApp han verificado el gran rendimiento de los bloques de construcción BeeGFS con hasta ocho sistemas DGX A100, una arquitectura que además permite un escalamiento fácil, adaptado a las necesidades del cliente.

En un reciente artículo publicado en el blog de NetApp, Mike McNamara líder senior de marketing de productos y soluciones en la compañía, explica que al agregar más bloques la arquitectura combinada de NetApp EF600 y Nvidia DGX A100 se puede escalar para agregar independientemente y con excelentes resultados un gran número de nodos de computación y una capacidad de almacenamiento a escala de petabytes, proporcionando la flexibilidad y potencia que requiere cualquier proyecto de desarrollo o implementación de aplicaciones de inteligencia artificial.

Comenta que las matrices EF600 son capaces de ofrecer un acceso constante y casi en tiempo real a los datos, a la vez que es capaz de soportar cualquier cantidad de cargas de trabajo de forma simultánea. Explica que estas matrices ofrecen hasta 2 millones de IOPS de lectura en caché, tiempos de respuesta de menos de 100 microsegundos y un ancho de banda de lectura secuencial de 42 Gbps en un solo gabinete. Todo ello con una confiabilidad del 99,9999%, que garantiza la máxima disponibilidad.

Además, afirma que el sistema de archivos paralelo BeeGFS proporciona la flexibilidad y escalabilidad que requieren las cargas de trabajo de inteligencia artificial más modernas. Así, esta combinación ganadora potencia los servicios de metadatos y almacenamiento, y liberando al controlador del computador principal de tareas como la supervisión de las unidades de almacenamiento o la detección del desgaste.

Este es un excelente ejemplo del trabajo conjunto que están realizando NetApp y Nvidia para desarrollar plataformas innovadoras para la informática de última generación. El resultado más reciente es la construcción de esta plataforma flexible, versátil y completamente verificada, que permite implementaciones a cualquier escala. De hecho, los expertos de NetApp destacan que se puede emparejar un solo DGX A100 con un solo bloque de construcción BeeGFS, o hasta 140 sistemas DGX A100 con un número completamente escalable de bloques BeeGFS que presenten un solo espacio de nombres de almacenamiento.

Esto habilita la creación de arquitecturas específicamente pensadas para ejecutar cargas de trabajo de inteligencia artificial en una amplia variedad de escenarios, desde las implementaciones empresariales más modestas a las grandes infraestructuras que se requieren en los centros de datos de la nube, enfocadas a trabajos de aprendizaje profundo basados en grandes volúmenes de datos.

Más información

¿Cuál es el futuro del mercado de almacenamiento? ¿Qué tecologías son las más adecuadas? Si quieres obtener más información sobre un segmento en crecimiento puedes visitar las páginas de nuestro colaborador NetApp.