Almacenamiento computacional de estado sólido diseñado para la supercomputación

- Noticias y Actualidad

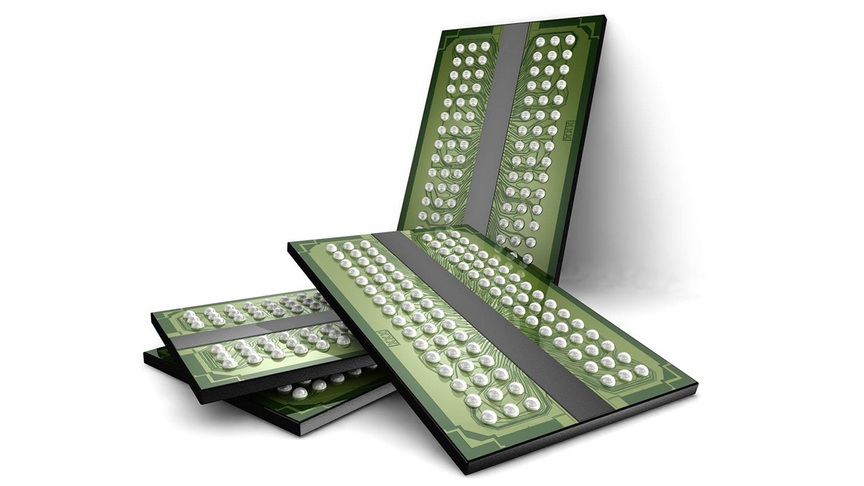

El Laboratorio Nacional de Los Álamos ha desarrollado una arquitectura de aceleración para plataformas de almacenamiento computacional SSD empleadas en el tratamiento de Big Data. Sus creadores se han enfocado especialmente en los proyectos de investigación científica y prometen un rendimiento entre 10 y 30 veces superior al de los sistemas actuales.

Los proyectos de investigación científica requieren plataformas informáticas capaces de almacenar y manipular los datos con una gran eficiencia y velocidad, por lo que en muchos casos se recurre a sistemas basados en unidades SSD. Esto ha permitido dar un salto cualitativo en el uso de Big Data para la investigación climática, genética, física y química, entre otros campos, y la industria continúa desarrollando nuevos sistemas para mejorar aún más el rendimiento.

Un buen ejemplo es el proyecto presentado recientemente por el Laboratorio Nacional de Los Álamos, en Estados Unidos. Junto con varios socios de la industria han desarrollado una arquitectura de aceleración del sistema de almacenamiento abierto para el análisis de datos científicos. Afirman que esta innovación proporciona un rendimiento entre 10 y 30 veces superior al de los sistemas actuales, lo que permitirá acelerar notablemente el trabajo de los investigadores.

Como explican en su anuncio, esta arquitectura permite la descarga de funciones intensivas a un dispositivo NAS programable y habilitado para acelerador que han denominado Caja Acelerada de Flash, o ABOF. Y el enfoque de esta nueva plataforma es convertirse en un componente fundamental de las futuras plataformas de Computación de Alto Rendimiento HPC empleadas en el Laboratorio Nacional de Los Alamos.

Según comenta Dominic Manno, investigador de la división HPC de esta institución, “los datos científicos y las técnicas de descubrimiento científico basadas en datos utilizadas para analizar esos datos están creciendo rápidamente. Realizar el análisis complejo para permitir el descubrimiento científico requiere grandes avances en el rendimiento y la eficiencia de los sistemas de almacenamiento de datos científicos”.

Ante estos requisitos el nuevo dispositivo programable ABOF permite aprovechar los grandes avances que se están realizando en el rendimiento de las redes y el almacenamiento de datos. Especialmente en lo que se refiere al almacenamiento computacional, que traslada ciertas operaciones de cálculo más cerca del almacenamiento, minimizando el movimiento de los datos y mejorando la eficiencia en aplicaciones de simulación y análisis de datos.

Los expertos explican que, aunque los sistemas informáticos escalables están adoptando DPUs (Data Processing Units) en la ruta de datos para acelerar las funciones intensivas entre las CPU y las unidades de almacenamiento, su integración en las plataformas de supercomputación todavía no logra aprovechar al máximo los avances en rendimiento y eficiencia. Pero con ABOF han creado un sistema que combina hardware y software del sistema de almacenamiento, que permite un uso más sencillo y eficiente de las DPU Nvidia BlueField-2 y otros aceleradores similares. Gracias a ello se logra descargar más operaciones intensivas de las CPU sin tener que realizar importantes modificaciones en el software de almacenamiento, permitiendo a los usuarios sacar más partido de ello.

En su artículo explican que la implementación actual de ABOF permite acelerar 3 áreas funcionales críticas necesarias para el funcionamiento del sistema de almacenamiento, que son la compresión, la codificación de borrado y las sumas de verificación. Estas funciones inciden directamente en el tiempo, el gasto y el uso general de energía en los sistemas de almacenamiento, especialmente en el sistema de archivos Linux Zettabyte (ZFS).

Tras el lanzamiento oficial de este nuevo sistema el pasado enero, sus creadores han realizado demostraciones internas tanto del hardware del dispositivo ABOF como de su software de soporte. Los resultados ahora publicados revelan importantes mejoras de rendimiento, y sus creadores explican que seguirán integrando un conjunto de funciones de análisis comunes en el sistema, lo que permitirá a los científicos analizar los datos utilizando la programación existente, sin necesidad de mover los datos y recursos de supercomputación. Con ello quieren proporcionar a la comunidad científica una herramienta sólida y fácilmente implementable para acelerar la resolución de los retos científicos más complejos de la actualidad.

Más información

¿Cuál es el futuro del mercado de almacenamiento? ¿Qué tecologías son las más adecuadas? Si quieres obtener más información sobre un segmento en crecimiento puedes visitar la página de nuestro colaborador Synology